이 논문은 내가 처음 세미나에서 발표한 논문이라 의미가 있다.

전기차 충전구를 감지하기 위해 새로운 dataset과 EnT-GAN을 제안하였다.

이쪽 연구를 열심히 하면 향후 자동 충전소 개발에 기여할 수 있을 것이라 생각한다.

IEEE Robot'22

https://arxiv.org/abs/2112.05290

Image-to-Image Translation-based Data Augmentation for Robust EV Charging Inlet Detection

This work addresses the task of electric vehicle (EV) charging inlet detection for autonomous EV charging robots. Recently, automated EV charging systems have received huge attention to improve users' experience and to efficiently utilize charging infrastr

arxiv.org

이 논문은 처음으로 전기차 충전을 위한 dataset을 만들었다.

또 Image-to-Image translation 방식으로 데이터를 augmentation 하였다.

이 Data Augmentation 과정을 거치고 기존 detection모델에 학습시켰다.

모델의 전체적인 흐름은 다음과 같다.

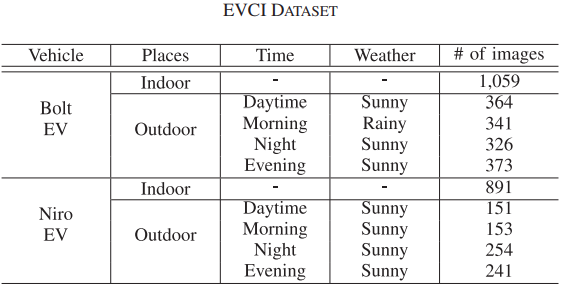

새로 개발한 EV Charging Inlet (EVCI) Dataset은 다음과 같다.

전체 데이터 개수는 총 4153개이며 자세한 내용은 다음과 같다.

Annotation은 다음과 같다.

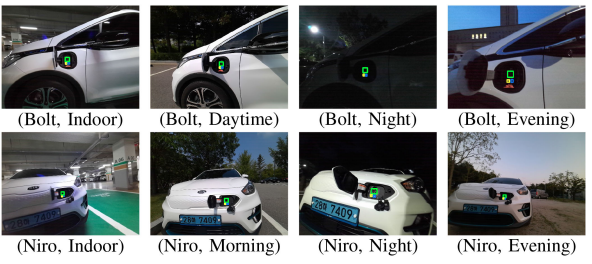

이에 따라 각 환경별 dataset samples은 다음과 같다.

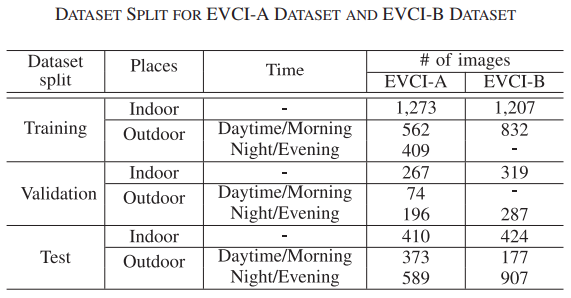

이 dataset은 EVCI-A, EVCI-B로 분리할 수 있다.

EVCI-A는 모든 환경을 담고있는 dataset이라 할 수 있다.

EVCI-B는 daytime/morning 시간대와 실내에서 찍은 사진으로 구성되어 있다.

다음 그래프는 data의 밝기, 대조, 채도별 분포를 나타낸다.

(a)는 Brightness

(b)는 RMS contrast

(c)는 Saturation를 나타낸다.

저자는 Image-to-Image 방식으로 이미지를 만들어낼 때

조명의 condition을 고려하려고 했다.

그래서 Environment Guide Vector라는것을 제안했다.

이 벡터(e ∈ R3)에는 brightness, contrast, saturation를 담고 있다.

다음과 같이 scatter로 EVCI 분포를 보면 위와 같이 Environment를 사용하는것이

합당하다는 것을 알 수 있다.

brightness (e'1)은 pixel-wise Iuminace의 평균으로 계산된다.

RMS(Root Mean Square) contrast는 pixel-wise Iuminace의 표준 편차인 contrast (e'2)에 사용된다.

saturation (e'3)는 pixel-wise saturatoin의 평균으로 계산된다.e는 e'를 [-1, 1]로 normalizing하여 구해진다.

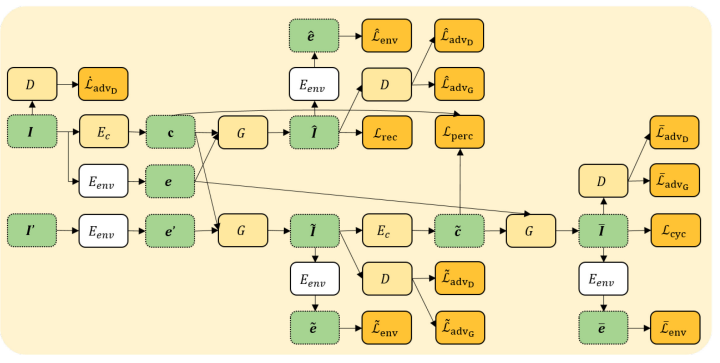

Ec와 Eenv는 각각 content encoder와 environment guide vector extractor다.

Ec는 이미지의 content 정보를 인코딩 하고

Eenv는 environment 정보를 추출한다.

c는 content map을 나타낸다.

G는 주어진 이미지로부터 c와 environment guide vector e를 가지고 이미지를 합성한다.

그리고 environment vector를 구하는 과정에서 c에 adaptive instance normalization (AdaIN)가 적용된다.

마지막으로 AdalIN layer의 output은 backbone에 들어간다.

다음은 Ent-GAN의 구조다.

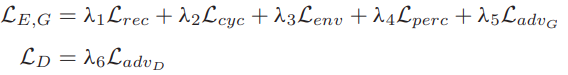

이 구조에는 여러 loss가 존재한다.

먼저 Image reconstruction loss는 다음과 같다.

Cycle constistency loss는 다음과 같다.

Environment translation loss는 다음과 같다.

Perceptual loss는 다음과 같다.

Adversarial loss는 다음과 같다.

S(·)는 downsampling 2다.

최종적인 loss는 다음과 같다.

λ1, λ2 = 10/hw

λ3 = 0.5

λ4 = 1/h'w'

λ5, λ6 = 0.5

(h, w), (h',w')는 input image의 높이-폭, content map의 높이-폭이다.

training은 다음과 같이 진행된다.

Detection은 기존에 있던 모델을 사용하였다.

그 중 DetectoRS를 사용하였지만 다른 모델도 사용 가능하다.

이 논문은 environment guide vector를 사용한 Ent-GAN으로

augmentation을 할 때 실제 환경과 비슷하도록 만들었다.

그리고 최초의 전기차 충전구 데이터 셋을 제안하였다.